|

Опрос

|

реклама

Быстрый переход

OpenAI и Anthropic начали активно привлекать маркетинговые кадры из других компаний

26.04.2026 [07:10],

Алексей Разин

Вряд ли кого-то в условиях бума искусственного интеллекта можно удивить «охотой за головами» среди разработчиков соответствующих систем. Она ведётся на всех уровнях и периодически создаёт информационные поводы о рекордных компенсационных пакетах, но CNBC добавляет, что теперь ведущие ИИ-стартапы типа OpenAI и Anthropic принялись искать и специалистов в сфере маркетинга, чтобы лучше продавать свои разработки.

Источник изображения: OpenAI Как отмечает источник, оба указанных стартапа в последнее время переманили сразу нескольких руководителей Salesforce, Snowflake и Datalog, чтобы с их помощью укрепить свои позиции в корпоративном сегменте рынка. Ярким примером может служить недавний переход Дениз Дрессер (Denise Dresser, на фото выше) из Salesforce на пост директора по выручке OpenAI. На прежнем месте работы она руководила коммуникационной платформой Slack. Продвижением решений OpenAI также будет заниматься Дженнифер Маджлесси (Jennifer Majlessi), которая имеет опыт работы в Salesforce, и этими фигурами дело не ограничивается, поскольку конкурирующая Anthropic также нанимала выходцев из Salesforce в последнее время. Руководители маркетинговых структур важны для ИИ-стартапов и благодаря наличию у них связей в корпоративной среде, которые сами по себе помогут эффективнее продвигать программное обеспечение и услуги OpenAI и Anthropic. Если последняя изначально больше ориентировалась на корпоративный рынок, то первая начала концентрироваться на нём относительно недавно. По состоянию на январь этого года, OpenAI уже получала 40 % всей выручки в корпоративном секторе, а к концу текущего года доля должна превысить 50 %. В ноябре было заявлено, что у OpenAI есть более 1 млн бизнес-пользователей по всему миру. Как добавляет источник, OpenAI также переманила недавно из Palantir технических специалистов, которые сопровождают внедрение программных продуктов на стороне клиента. Такой персонал необходим для более эффективного продвижения ИИ-решений на корпоративном рынке. Google инвестирует в Anthropic $40 млрд и предоставит 5 ГВт вычислительных мощностей на фоне обострившейся ИИ-гонки

25.04.2026 [06:50],

Дмитрий Федоров

Google инвестирует в Anthropic $40 млрд — $10 млрд сразу и ещё $30 млрд после достижения ИИ-стартапом целевых показателей. Кроме того, Google предоставит Anthropic дополнительные 5 ГВт вычислительных мощностей Google Cloud на ближайшие пять лет. Соглашение расширяет ранее объявленное партнёрство Anthropic с Google и производителем чипов Broadcom.

Источник изображения: BoliviaInteligente / unsplash.com Обещание инвестиций последовало за выпуском Mythos — новейшей и самой мощной ИИ-модели Anthropic, которую компания в этом месяце предоставила ограниченному кругу партнёров. В Anthropic заявляют, что модель имеет серьёзный потенциал в сфере кибербезопасности, однако из-за угрозы злоупотреблений широкий доступ к ней ограничен: компания совместно с избранными организациями оценивает и устраняет эти риски. При этом Mythos уже попала в руки тех, кому она не предназначалась. Отношения Anthropic с Google возникли задолго до событий этой недели. В начале месяца Anthropic объявила о партнёрстве с Google и производителем чипов Broadcom, который разрабатывает для Google ИИ-процессоры, для получения нескольких гигаватт вычислительных мощностей на базе тензорных процессоров (TPU), начиная с 2027 года. Broadcom затем отчиталась перед регулятором о предоставлении 3,5 ГВт. Новые инвестиции Google расширяют эту договорённость: Google Cloud предоставит дополнительные 5 ГВт мощностей в течение пяти лет с возможностью дальнейшего увеличения. Google — прямой конкурент Anthropic на рынке ИИ-моделей, но одновременно и ключевой поставщик инфраструктуры. Anthropic во многом зависит от Google Cloud в части процессоров, в том числе TPU — специализированных чипов для ИИ-задач, которые считаются одной из лучших альтернатив востребованным процессорам Nvidia. Гонку в области ИИ всё сильнее определяет доступ к вычислительным мощностям для обучения и развёртывания ИИ-моделей. OpenAI активно наращивает ресурсы через сеть сделок на сотни миллиардов долларов с облачными провайдерами, производителями процессоров и энергетическими компаниями, в том числе расширив в этом месяце соглашение с производителем чипов Cerebras. Anthropic ведёт жёсткую борьбу за мощности. В последние недели компания столкнулась с массовыми жалобами на ограничения при работе с Claude и ответила серией инфраструктурных сделок. Ранее в этом месяце Anthropic заключила соглашение с облачным провайдером CoreWeave на мощности ЦОД. На этой неделе компания привлекла дополнительные $5 млрд от Amazon — часть масштабного соглашения, по которому Anthropic, как ожидается, потратит до $100 млрд на вычислительные мощности объёмом около 5 ГВт. Ещё в феврале оценка Anthropic составляла $350 млрд, теперь же инвесторы готовы вкладываться в компанию исходя из оценки в $800 млрд и даже выше. По имеющимся данным, компания рассматривает возможность выхода на биржу уже в октябре этого года. Anthropic: у нас нет «рубильника» от ИИ-моделей Claude в секретных системах Пентагона

23.04.2026 [13:29],

Дмитрий Федоров

Anthropic заявила, что после развёртывания ИИ-моделей Claude в секретных системах Пентагона у компании нет ни доступа к ним, ни технической возможности их отключить, изменить или повлиять на их работу. Этот довод прямо опровергает центральный тезис военного министра Питера Хегсета (Peter Hegseth), обосновавшего присвоение Anthropic статуса угрозы для цепочки поставок.

Источник изображения: anthropic.com В 60-страничной жалобе (дело № 26-1049), поданной Anthropic в Апелляционный суд округа Колумбия, подробно описывается архитектура развёртывания Claude в закрытых контурах Пентагона. Развёрнутая ИИ-модель статична: она не деградирует и не меняется сама по себе, Anthropic не может отправить в неё обновление, внедрить уязвимость или дистанционно отключить её. У компании нет «рубильника», нет бэкдора, нет удалённого доступа, а инженеры Anthropic не могут войти в систему Министерства войны США (DOW), чтобы изменить работающую модель. До развёртывания правительство самостоятельно тестирует каждую ИИ-модель и проводит многоуровневую оценку её поведения. Если инженеры Anthropic с допуском к секретным данным всё же получают доступ к развёрнутой модели, то исключительно по решению ведомства и под его жесточайшим контролем. Этот технический факт подрывает главный аргумент министра Хегсета. В обосновании статуса угрозы, подготовленном заместителем министра по исследованиям и разработкам Эмилом Майклом (Emil Michael), утверждалось, что Anthropic стремится получить «операционное вето» над военными операциями и может «тайно изменить» Claude или «отключить свою технологию» прямо в ходе боевых действий. Anthropic называет эти утверждения необоснованными, потому что физически не может сделать ничего из перечисленного. Конфликт вырос из спора о двух пунктах политики допустимого использования Claude. Anthropic готова была расширить перечень разрешённых военных применений ИИ-модели, однако отказалась снять два ограничения: запрет на применение Claude для летального автономного оружия и для массовой слежки за американскими гражданами. Компания объяснила, что Claude недостаточно надёжен для подобных задач. Ошибка ИИ в автономном боевом решении грозит гибелью военнослужащих или мирных жителей, а существующая правовая база не учитывает масштаб обработки данных, доступный ИИ-системам. Пентагон, прежде принимавший эти ограничения, в сентябре 2025 года впервые потребовал разрешить «все законные применения» Claude. Переговоры длились несколько месяцев. 24 февраля 2026 года Хегсет на личной встрече с гендиректором и сооснователем Anthropic Дарио Амодеи (Dario Amodei) назвал возможности Claude выдающимися и сказал, что хотел бы работать с компанией, но тут же выдвинул ультиматум: если к 27 февраля Anthropic не согласится, ведомство присвоит ей статус угрозы для цепочки поставок. Амодеи публично ответил 26 февраля: решения о военных операциях принимает Пентагон, а не частные компании, но Anthropic «не может по совести» принять условия министра. Anthropic указывает на прямое противоречие в действиях министра: нельзя одновременно объявлять компанию угрозой национальной безопасности и требовать, чтобы её технология оставалась в боевых системах ещё полгода. Кроме того, переговоры с Пентагоном продолжались даже после официального присвоения статуса. Статус угрозы распространяется на все продукты и услуги Anthropic, на все виды контрактов с Пентагоном, как прямых, так и субподрядных. DOW расторгло двухлетнее соглашение с Anthropic стоимостью до $200 млн. Меморандум от 6 марта обязал все подразделения ведомства прекратить использование продукции Anthropic и исключить компанию из списков одобренных поставщиков в течение 180 дней. Апелляционный суд округа Колумбия отказал Anthropic в приостановке действия статуса угрозы, но назначил ускоренное рассмотрение дела по существу, признав, что «Anthropic выдвигает серьёзные доводы и, вероятно, понесёт непоправимый ущерб в ходе разбирательства». Новые слушания назначены на 19 мая 2026 года. Параллельно судья Северного округа Калифорнии вынес предварительный судебный запрет по смежному делу, в котором оспаривается присвоение статуса угрозы. В итоге Anthropic не может заключать новые контракты с Пентагоном, но продолжает работать с другими федеральными ведомствами. Ни одна организация или частное лицо не подали в суд заключения в поддержку Пентагона. На стороне Anthropic подали заключения десятки организаций и частных лиц — от Американского союза защиты гражданских свобод (ACLU) и Electronic Frontier Foundation (EFF) до 149 бывших судей, отставных старших офицеров вооружённых сил и Американской федерации учителей (AFT). Anthropic обогнала OpenAI — по оценке на вторичном рынке акций, которая взлетела до $1 трлн за три месяца

23.04.2026 [10:33],

Дмитрий Федоров

Оценка Anthropic на внебиржевом рынке акций непубличных компаний достигла $1 трлн — против $380 млрд три месяца назад и выше, чем у OpenAI, которая оценивается в $880 млрд. Однако предложение иссякает: один акционер выставил пакет акций по цене $1,15 трлн, но крупный фонд заявил о готовности купить бумаги по $1,05 трлн, при этом покупатели перехватывают сделки в течение суток.

Источник изображения: anthropic.com Генеральный директор Forge Global Келли Родригес (Kelly Rodriques) сообщил, что оценка Anthropic на платформе сегодня превышает $1 трлн, а OpenAI торгуется по $880 млрд — незначительно выше уровня мартовского раунда. Поскольку обе компании ещё не вышли на биржу, большинство инвесторов вынуждены покупать бумаги на внебиржевом рынке — у действующих или бывших сотрудников и ранних инвесторов. По данным Кена Сойера (Ken Sawyer), сооснователя и управляющего партнёра Saints Capital, один из акционеров Anthropic недавно предложил пакет акций по цене $1,15 трлн. Джесси Леймгрубер (Jesse Leimgruber), основатель OpenHome, сообщил в соцсети X, что крупный фонд готов купить те же бумаги при оценке $1,05 трлн. Некоторые покупатели даже предлагают собственную недвижимость в обмен на акции Anthropic. Три месяца назад Anthropic закрыла раунд финансирования под руководством GIC и Coatue с оценкой $380 млрд. С тех пор интерес к бумагам компании резко вырос — инвесторов впечатлили стремительный рост выручки и популярность Claude Code у разработчиков. За последние недели венчурные фонды несколько раз предлагали купить акции Anthropic, оценивая компанию в $800 млрд. «Для Anthropic это был грандиозный забег, — говорит Глен Андерсон (Glen Anderson), генеральный директор Rainmaker Securities, инвестиционного банка, специализирующегося на операциях с бумагами непубличных компаний. — Все хотят войти в историю ИИ, а Anthropic сейчас занимает в ней первую позицию». Андерсон только что получил предложение о покупке пакета акций Anthropic стоимостью $960 млрд, однако ожидает, что другой покупатель согласится раньше, чем он успеет оценить сделку. «Получаем предложение — и уже на следующий день кто-то его перехватывает. Продавцов почти нет», — говорит он. По словам Андерсона, значительная часть спроса объясняется страхом упустить возможность, а не фундаментальными показателями: инвесторы из венчурных и семейных фондов готовы платить любую цену, чтобы только стать акционерами Anthropic. «Дело уже не столько в доходности, сколько в том, чтобы сказать: я инвестор Anthropic. Это и разгоняет цену», — отмечает он. По словам Андерсона, спрос на акции OpenAI в этом году резко ослаб: заявки ниже уровня последнего раунда в $852 млрд. «Рынок OpenAI совсем вялый. Настроения явно сместились в сторону Anthropic», — констатирует он. Брэдли Горовиц (Bradley Horowitz), генеральный партнёр Wisdom Ventures — раннего инвестора как в Anthropic, так и в OpenAI, — рассказал, что фонд получает предложения о продаже акций каждый день, но игнорирует их. «Предложения поступают ежедневно — от смехотворных до вполне серьёзных. Я едва открываю такие письма: нас это не интересует. Мы играем в долгую», — заявил он. В популярном ИИ-протоколе нашли критическую уязвимость — отвечающая за него Anthropic ничего исправлять не будет

22.04.2026 [16:16],

Павел Котов

Исследователи в области кибербезопасности из компании OX Security обнаружили уязвимость в протоколе MCP (Model Context Protocol), работающую на уровне его архитектуры. Она затрагивает официальные SDK для языков Python, TypeScript, Java и Rust. Под угрозой программные решения со 150 млн загрузок и до 200 тыс. экземпляров серверов. Anthropic заявила, что вносить изменения в протокол не требуется, потому что такое поведение «ожидаемо».

Источник изображений: anthropic.com Anthropic представила открытый стандарт MCP в 2024 году — он позволяет моделям искусственного интеллекта подключаться к внешним инструментам, базам данных и API. В прошлом году компания передала его в Agentic AI Foundation при Linux Foundation; сейчас протокол используется в OpenAI, Google и в большинстве инструментов разработки с использованием ИИ. Уязвимость связана с тем, как MCP обрабатывает запросы через интерфейс STDIO — запросы передаются в точку выполнения команд без дополнительной проверки. То есть каждый использующий MCP разработчик автоматически наследует эту уязвимость. Эксперты OX Security сформулировали четыре возможных семейства эксплойтов для этой уязвимости: внедрение вредоносного кода в пользовательский интерфейс без авторизации; обход средств безопасности на считающихся защищёнными платформах вроде Flowise; внедрение вредоносных запросов для IDE-сред, в том числе Windsurf и Cursor, которые могут выполняться без участия пользователя; и распространение вредоносных пакетов через платформы MCP. Чтобы подтвердить свою гипотезу, исследователи успешно внедрили тестовую полезную нагрузку в 9 из 11 реестров MCP и подтвердили возможность выполнения команд на шести рабочих коммерческих платформах.  В рамках исследования были установлены не менее десятка частных уязвимостей с высоким или критическим рейтингом. Уязвимости шлюза LiteLLM (CVE-2026-30623) и платформы Bisheng (CVE-2026-33224) значатся как закрытые; уязвимость Windsurf (CVE-2026-30615), допускающая локальное выполнение кода без участия пользователя имеет статус «сообщение получено» — тот же статус у уязвимостей открытых проектов GPT Researcher, Agent Zero, LangChain-Chatchat и DocsGPT. OX Security, по её собственному заявлению, неоднократно рекомендовала Anthropic исправить эти уязвимости на уровне протокола, например, разрешив выполнять запросы только из манифеста или предусмотрев список разрешённых команд на уровне SDK, но в Anthropic ответили отказом и не стали возражать против оглашения информации об уязвимости. При этом сейчас сама Anthropic расследует факт неавторизованного доступа к передовой модели Mythos; ранее компания также допустила утечку исходного кода сервиса Claude Code. Сейчас управление MCP передано Linux Foundation, но Anthropic всё ещё осуществляет поддержку эталонных SDK, в которых обнаружена уязвимость. Пока механизм работы STDIO не изменится, разработчикам придётся собственными силами реализовывать средства очистки входных данных. Потенциально опасная ИИ-модель Anthropic Mythos нашла 271 уязвимость в Firefox 150

22.04.2026 [12:20],

Павел Котов

Пока общественность пытается разобраться, действительно ли вышедшая в конце марта модель искусственного интеллекта Anthropic Mythos слишком опасна для выпуска в общий доступ, или разработчик просто искусственно создаёт на ней ажиотаж, в Mozilla испытали её возможности на собственном продукте.

Источник изображения: blog.mozilla.org Разработчики Mozilla получили ранний доступ к Anthropic Mythos, и ИИ помог им обнаружить в вышедшем на этой неделе обновлении браузера Firefox 150 колоссальное число уязвимостей — 271 штуку. Результат оказался настолько значительным, чтобы технический директор Firefox Бобби Холли (Bobby Holley) с энтузиазмом констатировал, что в бесконечной борьбе киберпреступников и киберзащитников у последних «наконец-то появился шанс одержать решительную победу». Для сравнения, в марте общедоступная модель Anthropic Opus 4.6 провела анализ кода Firefox 148 и нашла «всего» 22 уязвимости. Обычно, отметил господин Холли, уязвимости обнаруживаются либо методом «фаззинга» — хаотической бомбардировки ПО случайными данными — либо посредством долгосрочного анализа с привлечением «элитных исследователей в области безопасности». Anthropic Mythos избавляет разработчиков от применения серьёзных ресурсов, которые требуют продолжительного времени и усилий. Но теперь создателям ПО придётся ввести в повседневную практику анализ кода с помощью ИИ, потому что множество ошибок скрывается в каждом продукте, и теперь их можно обнаруживать. Особенно важно это для проектов с открытым исходным кодом, чьи базы кода свободно лежат в общем доступе. Исследования безопасности для таких проектов обычно проводят добровольцы, но их усилий, конечно, недостаточно. И разработчикам наиболее популярных проектов, которыми пользуются миллиарды человек, отметили в Mozilla, доступ к средствам вроде Anthropic Mythos должен предоставляться в приоритетном порядке. Сверхмощная ИИ-модель Mythos попала не в те руки, но это не точно — Anthropic расследует инцидент

22.04.2026 [08:39],

Алексей Разин

Выпущенная Anthropic ИИ-модель Mythos, которая с помощью технологий искусственного интеллекта ищет уязвимости в программном обеспечении, изначально была предложена в ограниченном доступе из соображений безопасности. Теперь появились сведения о первом инциденте получения к Claude Mythos Preview несанкционированного доступа сторонними пользователями.

Источник изображения: Anthropic Впрочем, как поясняет Financial Times со ссылкой на комментарии представителей Anthropic, получившие доступ к Claud Mythos Preview лица не были случайными в полной мере, поскольку связаны с подрядчиками, работающими на саму Anthropic. Сама по себе информация о подобном инциденте только усилит обеспокоенность регуляторов во многих уголках мира. В частности, власти Австралии, Южной Кореи и Японии уже озабочены тем, что Mythos в руках злоумышленников может представлять угрозу для национальных банковских систем. Anthropic пока не располагает доказательствами того, что активность пользователей, получивших доступ к Mythos через подрядчика, распространилась за пределы контролируемого окружения. Кто именно из партнёров Anthropic замешан в этом инциденте, не уточняется. Считается, что доступ к Mythos получили примерно 40 организаций, но публично Anthropic называет имена лишь малой части из них, включая Amazon, Microsoft, Apple, Cisco и CrowdStrike. Эти компании получили приоритетное право использования ИИ-модели Mythos до того, как она выйдет на рынок с более серьёзным охватом. Специалисты по кибербезопасности предупредили, что Mythos позволяет злоумышленникам использовать уязвимости в ПО быстрее, чем их разработчики смогут их устранить. В марте описание ИИ-модели попало в публичный доступ через кеш данных, после чего Anthropic резко усилила внутренние меры безопасности, стараясь предотвратить более серьёзные утечки. Впрочем, это не предотвратило апрельскую утечку программного кода Claude Code, который предназначался для служебного использования. Amazon согласилась вложить в Anthropic ещё $25 млрд

21.04.2026 [05:05],

Алексей Разин

Большинство ИИ-стартапов стремительное развитие своих сервисов обеспечивают благодаря аренде вычислительных мощностей у облачных провайдеров, последние несут на себе бремя капитальных затрат. Amazon недавно согласилась вложить в Anthropic ещё $25 млрд, а последняя зарезервировала за собой до 5 ГВт вычислительных мощностей.

Источник изображения: Amazon За предыдущие годы, как отмечает CNBC, компания Amazon (AWS) уже вложила в Anthropic около $8 млрд, но теперь готова направить на нужды стартапа ещё $25 млрд. На оплату услуг AWS американский стартап готов потратить более $100 млрд в ближайшие десять лет, в том числе используя процессоры Trainium разработки Amazon в профильной вычислительной инфраструктуре. В ближайшее время Anthropic получит от Amazon первые $5 млрд, а последующие $20 млрд будут инвестированы поэтапно, в зависимости от достижения обозначенных партнёрами промежуточных целей. Уже к концу этого года в распоряжении Anthropic окажется дополнительный 1 ГВт вычислительной мощности на базе процессоров Trainium2 и Trainium3. Всего в этом году Amazon направит на капитальные расходы почти $200 млрд, в основном они будут использованы для строительства инфраструктуры ИИ. Пару месяцев назад Amazon согласилась направить на нужды OpenAI около $50 млрд, поэтому Anthropic является не единственным ИИ-стартапом, который может претендовать на поддержку Amazon. Сделка с последней позволит Anthropic быстрее наращивать вычислительные мощности, используемые в работе с Claude. Хотя AWS остаётся главным облачным провайдером Anthropic, у стартапа также имеются профильные контракты с Microsoft и Google. Первая согласилась в ноябре прошлого года вложить в Anthropic до $5 млрд, а разработчики Claude взяли на себя обязательства арендовать вычислительные мощности Azure на общую сумму $30 млрд. В этом месяце Anthropic договорилась с Google и Broadcom об использовании нескольких гигаватт вычислительных мощностей. АНБ США продолжает использовать Anthropic Mythos, несмотря на запрет

20.04.2026 [10:11],

Алексей Разин

Пока правительство США пытается определиться, можно ли дальше использовать разработки компании Anthropic в условиях объявления её источником риска для национальной безопасности, отдельные ведомства продолжают работать с ИИ-моделями этого разработчика, и Агентство национальной безопасности (АНБ) является одной из таких «непокорных» правительственных структур.

Источник изображения: Anthropic Как сообщило издание Axios, Агентство национальной безопасности США использует одну из самых производительных ИИ-моделей Anthropic — Mythos Preview, хотя прекрасно осознаёт, что курирующее работу ведомства Министерство обороны США неодобрительно относится к такой практике. Складывается, по словам источника, парадоксальная ситуация: с одной стороны, американские военные расширяют использование продуктов Anthropic, а с другой — пытаются в суде доказать, что они представляют угрозу для национальной безопасности Соединённых Штатов. Минимум два источника подтвердили Axios, что внутри АНБ модель Mythos для поиска уязвимостей в программном обеспечении не только используется, но и в определённом смысле набирает популярность. Обычно данный инструмент используется при аудите собственной программной инфраструктуры на предмет поиска слабых мест. Сама Anthropic ограничила круг доступа к Mythos примерно 40 организациями, которые могут применять ИИ-модель ответственно и безопасно. Из этих организаций названы были лишь 12, поэтому АНБ может попасть в оставшуюся часть выборки. Некоторые из них находятся за пределами США — в частности, в Великобритании. Важность данного программного инструмента подчёркивается и тем фактом, что глава Anthropic Дарио Амодеи (Dario Amodei) отправился в пятницу на встречу с высокопоставленными американскими чиновниками, и темой переговоров стало именно использование Mythos правительственными структурами. Предполагается, что по итогам встречи должен быть определён порядок предоставления доступа к Mythos прочим организациям, помимо Пентагона. ИИ-модель Mythos заставила власти США пойти на контакт с «угрожающей национальной безопасности» Anthropic

19.04.2026 [18:53],

Дмитрий Федоров

Глава Anthropic встретится с руководителем аппарата Белого дома на фоне опасений, связанных с новой ИИ-моделью Mythos, способной выявлять уязвимости в программном коде. По данным Anthropic, эта модель уже обнаружила тысячи брешей во всех основных операционных системах (ОС) и браузерах, и теперь её возможности изучают чиновники из окружения президента США.

Источник изображения: anthropic.com Встреча Дарио Амодеи (Dario Amodei) с руководителем аппарата Белого дома Сьюзи Уайлс (Susie Wiles) происходит в условиях острого противоречия: администрация одновременно пытается занести Anthropic в «чёрный список» и вынуждена взаимодействовать с ней по вопросам кибербезопасности. Чиновники Белого дома и Национального института стандартов и технологий (NIST) анализируют последствия запуска Mythos и рассматривают расширение доступа к модели для федеральных ведомств — следует из внутренней переписки, полученной The Washington Post. Особую обеспокоенность испытывают Уайлс, вице-президент Джей Ди Вэнс (JD Vance) и министр финансов Скотт Бессент (Scott Bessent), рассказал источник, знакомый с ходом переговоров. Anthropic не стала публично выпускать ИИ-модель и создала коалицию крупных технологических корпораций для оценки рисков в рамках инициативы Project Glasswing. Государственные органы по кибербезопасности компания уведомила заранее. «Учитывая темпы развития ИИ, пройдёт немного времени, прежде чем подобные возможности распространятся — возможно, среди тех, кто не намерен применять их ответственно, — говорится в официальном заявлении компании. — Последствия для экономики, общественной безопасности и национальной безопасности могут оказаться серьёзными». OpenAI тем временем завершает разработку собственного ИИ следующего поколения под кодовым названием Spud. Федеральные ведомства среагировали быстро. Бессент и глава Федеральной резервной системы Джером Пауэлл (Jerome Powell) собрали в Вашингтоне руководителей крупнейших банков, призвав их серьёзно отнестись к угрозам. «Я уверен, что все теперь гребут в одном направлении — создают устойчивость», — заявил Бессент в интервью CNBC в среду. Anthropic стала первой крупной ИИ-компанией, получившей допуск к засекреченным системам федеральных ведомств. Отношения дали трещину, когда Пентагон потребовал права применять Claude в любых законных целях, включая управление автономным оружием и массовую слежку. Амодеи ответил отказом, но позже встретился с министром войны Питом Хегсетом (Pete Hegseth), однако переговоры зашли в тупик в конце февраля. Суд Сан-Франциско признал внесение компании в «чёрный список» незаконным, однако апелляционный суд в Вашингтоне вынес предварительное решение, сохранив запрет в силе. Несмотря на официальный разрыв с Пентагоном, Claude остался интегрирован в военные системы, поэтому в ту же ночь, когда администрация объявила о прекращении сотрудничества, ИИ-модель использовалась для поддержки авиационных ударов по Ирану. Чтобы восстановить отношения с Белым домом, в марте Anthropic наняла лоббиста Брайана Балларда (Brian Ballard), имеющего тесные связи с командой президента, потратив на это $130 000. Глава Anthropic предрёк исчезновение инженерных профессий — и открыл 429 вакансий с зарплатой до $405 000 в год

19.04.2026 [06:22],

Дмитрий Федоров

Глава Anthropic Дарио Амодеи (Dario Amodei) предупреждает об исчезновении инженерных профессий по мере того, как ИИ берёт на себя написание кода, — и одновременно открывает около 429 вакансий для разработчиков с зарплатой до $405 000. Противоречие обнажает переходный момент: ИИ меняет характер инженерного труда, но заместить специалистов полностью пока не может.

Источник изображений: anthropic.com На протяжении нескольких месяцев Амодеи последовательно предупреждает, что начальные инженерные позиции окажутся под ударом первыми — рутинным кодингом уже занимаются ИИ-системы. «Думаю, что написание кода исчезнет первым — или, точнее, им первым займутся ИИ-модели», — сказал он в ходе одной из недавних дискуссий, разграничив собственно кодинг и более широкий круг инженерных обязанностей. По его прогнозу, уже через 12 месяцев ИИ будет писать фактически весь код, а в обозримом будущем доля машинного кода во многих компаниях достигнет 90 %. Внутри самой Anthropic трансформация идёт уже сейчас. Часть руководителей инженерных команд перестала писать код самостоятельно и переключилась на проверку и доработку того, что для них генерирует ИИ. Один из внутренних инструментов в компании собрали менее чем за 2 недели преимущественно на машинном коде — прежде такие задачи занимали значительно больше времени. Амодеи не исключает, что со временем потребность в инженерах снизится и внутри самой компании: «В будущем нам самим потребуется меньше разработчиков, чем сегодня».  Тем не менее, страница вакансий Anthropic насчитывает около 429 открытых позиций в разработке — инженер-исследователь, full-stack-разработчик, инженер по производительности, руководитель инженерного направления — с вилкой от $320 000 до $405 000 в год. Разрыв между прогнозом и кадровой практикой объясняется хронологией: ИИ снижает потребность в рутинном кодинге, однако разработка и совершенствование самих ИИ-систем требует глубокой технической экспертизы, которую компании вроде Anthropic продолжают наращивать. Амодеи признаёт, что даже при широкой автоматизации кодинга инженеры сохранят ключевую роль: формулировать условия задачи, принимать архитектурные решения, обеспечивать совместимость с существующим кодом и отвечать за безопасность. Параллельно, по его словам, возникнут новые специализации — в частности, «специалист по внедрению информационных систем» (англ. — forward deployed engineer): специалист, сочетающий технические компетенции с пониманием потребностей клиентов и помогающий внедрять ИИ-решения на практике. Открытым остаётся вопрос, что произойдёт, если ИИ научится управлять и этими задачами. Anthropic выпустила Claude Design — дизайнерский ИИ для тех, кто в дизайне ничего не понимает

17.04.2026 [20:22],

Николай Хижняк

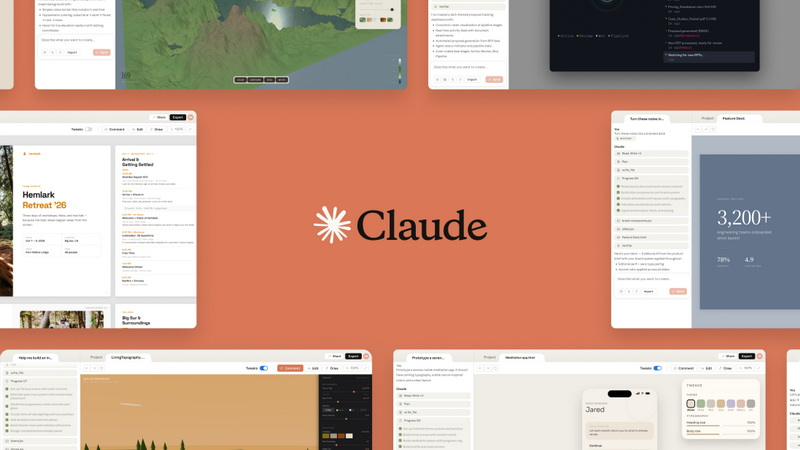

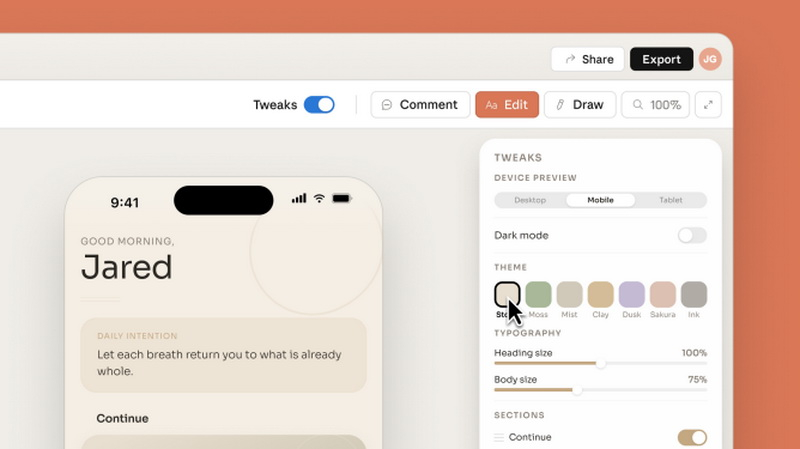

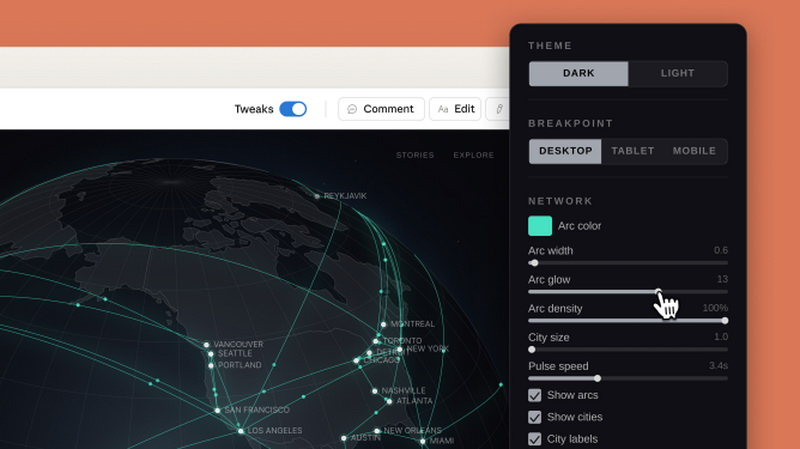

Компания Anthropic объявила о запуске Claude Design — нового экспериментального инструмента визуального дизайна, который позволяет создавать визуальные материалы, такие как прототипы, слайды, одностраничные макеты и многое другое, с помощью ИИ Claude.

Источник изображений: Anthropic По словам разработчиков, Claude Design призван помочь основателям стартапов и менеджерам продуктов, не имеющим опыта в дизайне, проще делиться своими идеями. С помощью Claude Design пользователи описывают, что им нужно, а Claude создаёт первоначальную версию дизайна. Затем пользователи могут дорабатывать визуальные материалы, внося правки самостоятельно или отправляя запросы ИИ. Например, можно попросить Claude «создать прототип приложения для безмятежной мобильной медитации. Оно должно быть с успокаивающей типографикой, неброскими природными мотивами в оформлении и лаконичным макетом». Затем можно попросить ИИ изменить цвета, размер шрифта или добавить переключатель тёмного режима.  Может показаться, что Claude Design создан для конкуренции с популярным приложением для дизайна Canva, которое недавно расширило свои возможности в области искусственного интеллекта. Однако в разговоре с TechCrunch представители Anthropic сообщили, что их новый продукт призван дополнить Canva, а не заменить его. По их словам, Claude Design создан для тех, кто не изучал программное обеспечение для дизайна, а также для тех, кому нужно быстро воплотить свою идею в визуальном оформлении. После создания презентации или прототипа, их можно экспортировать в формате PDF, по URL-адресу, в виде файлов PPTX или отправить в Canva. По словам Anthropic, в Canva эти файлы можно редактировать, а также совместно дорабатывать.  Claude Design может имитировать общий стиль проекта, чтобы результаты, сгенерированные ИИ, соответствовали общему визуальному стилю компании. По словам представителей Anthropic, Claude Design делает это, анализируя кодовую базу и файлы дизайна компании. Кроме того, команды могут дорабатывать эти компоненты и использовать несколько дизайн-систем. Новый продукт создан на базе Claude Opus 4.7 и доступен в режиме исследовательской предварительной версии для подписчиков Claude Pro, Max, Team и Enterprise. Как отмечает портал TechCrunch, запуск Claude Design говорит о том, что Anthropic хочет выйти на корпоративный рынок и рынок профессиональных пользователей на фоне растущей конкуренции в сфере инструментов для работы с искусственным интеллектом. В январе Anthropic представила Claude Cowork — агентного ИИ-помощника для решения сложных задач. Спустя несколько недель после этого компания представила в Cowork агентские плагины, предназначенные для автоматизации специализированных задач в различных подразделениях компании. В ИИ по паспорту: для доступа к некоторым функциям Anthropic Claude потребуется подтвердить личность

17.04.2026 [15:34],

Павел Котов

Для работы с некоторыми функциями платформы искусственного интеллекта Anthropic Claude пользователям вскоре потребуется подтвердить свою личность, предъявив документ государственного образца — например, паспорт или водительское удостоверение.

Источник изображения: anthropic.com

«Ответственная работа с мощными технологиями начинается с понимания того, кто ими пользуется. Проверка личности поможет нам не допустить злоупотреблений, обеспечить соблюдение наших правил и выполнить юридические обязательства. Мы внедрим проверку личности для нескольких сценариев использования, и при доступе к определённым функциям вы можете увидеть запрос на подтверждение [личности] в рамках наших плановых проверок целостности платформы или иных мер безопасности и соблюдения требований», — пояснили инициативу в компании. Процедура верификации также может потребовать, чтобы пользователь в реальном времени снял автопортрет на смартфон или веб-камеру — это «обычно занимает менее пяти минут». В качестве удостоверений личности будут приниматься документы, выданные государственными органами «большинства стран» при наличии фотографии. Это может быть паспорт, водительское удостоверение, удостоверение личности, выданное властями штата, провинции или федеральными властями. Anthropic не будет принимать фотокопии, скриншоты, сканы или фотографии фотографий — вместе с ними не подойдут цифровые удостоверения личности или их варианты для мобильных устройств, студенческие билеты, пропуска на предприятия, читательские билеты, банковские карты или временные бумажные удостоверения личности. Компания заверила, что информация не будет использоваться для обучения ИИ — данные будут храниться в системах Persona для обработки от имени Anthropic, то есть последняя сможет при необходимости запросить к ним доступ, но она обязалась не копировать и не хранить эти изображения. «Мы не передаём ваши идентификационные данные никому другому. Данные проверки останутся между нами, Persona и Anthropic, за исключением случаев, когда мы юридически обязаны отвечать на действительные юридические запросы. Ваши данные проверки никогда не будут переданы третьим лицам в целях маркетинга, рекламы или любых целях, не связанных с проверкой или соблюдением требований», — подчеркнули в Anthropic. Чат-бот Anthropic Claude Opus написал эксплойт для Google Chrome всего за $2283

17.04.2026 [13:29],

Павел Котов

Исследователь в области кибербезопасности Мохан Педхапати (Mohan Pedhapati) рассказал, как при помощи модели искусственного интеллекта Anthropic Claude Opus 4.6 написал полную цепочку эксплойтов для взлома движка JavaScript V8 в браузере Google Chrome 138, на котором работает актуальный клиент Discord.

Источник изображения: anthropic.com Процесс написания цепочки эксплойтов занял неделю, сообщил исследователь — в процессе были израсходованы 2,3 млрд токенов и $2283 за доступ к ИИ-модели через API; он также приложил собственные усилия, в общей сложности проведя 20 часов в решении задач по устранению тупиковых ситуаций. Сумма, в которую обошлось создание схемы взлома, представляется значительной для одиночки, признал Мохан Педхапати; с другой стороны, без посторонней помощи человек работал бы над аналогичным проектом несколько недель. Проект оказался выгодным и в экономическом плане — вознаграждение от Google и Discord за сообщение о таком эксплойте может составить около $15 000. И это только легальный рынок — за уязвимость нулевого дня киберпреступники могли бы заплатить другие деньги. Многие сервисы выпускают свои приложения на фреймворке Electron, который, в свою очередь, основывается на Chrome — так делают не только в Discord, но и, например, в Slack. Вот только актуальный код фреймворка на одну версию отстаёт от браузера, а разработчики приложений не всегда оперативно обновляют зависимости, да и пользователи не всегда ставят последние версии приложений. Клиент Discord автор опыта выбрал потому, что он работает на Chrome 138, то есть отстаёт от текущей версии браузера на девять основных версий. Любой начинающий программист, указывает Мохан Педхапати, при наличии достаточного терпения и ключа API для доступа к ИИ-модели способен взломать необновлённое ПО — «это вопрос времени, а не вероятности». Более того, «каждый патч — это, по сути, подсказка для эксплойта», потому что проекты с открытым исходным кодом разрабатываются прозрачно, то есть исправления часто оказываются общедоступными в коде ещё до того, как выпускается обновлённая версия программы в целом. Чтобы защитить приложения от подобных атак, эксперт рекомендует внимательнее следить за зависимостями и оперативно вносить изменения, а также выпускать патчи безопасности автоматически, чтобы пользовательское ПО не оставалось уязвимым, если обновление установить просто забыли. Наконец, проектам с открытым исходным кодом следует соблюдать осторожность при публикации подробных данных об уязвимостях. Несмотря на конфликт, Белый дом ведёт переговоры с Anthropic о доступе к мощному ИИ Claude Mythos

17.04.2026 [13:27],

Анжелла Марина

Администрация Дональда Трампа (Donald Trump) начала переговоры с компанией Anthropic о доступе к её новой большой языковой модели Claude Mythos Preview для нужд федерального правительства. Обсуждение развернулось на фоне продолжающихся попыток Пентагона внести компанию в чёрный список неблагонадёжных поставщиков.

CEO Dario Amodei, Anthropic. Источник изображения: wikipedia.org Как стало известно Axios, Белый дом и представители Anthropic уже согласовывают условия, при которых государственные агентства смогут использовать технологию в ближайшие недели. Управление по управлению и бюджету уже уведомило заинтересованные ведомства о том, что «вопрос изучается», хотя официальный запрет для структур, работающих с военными, остаётся в силе. Напомним, ключевые разногласия сосредоточены вокруг Министерства обороны, которое требует права на использование ИИ в законных целях. Anthropic отказывается предоставлять такие возможности, опасаясь применения своих технологий для массовой слежки или создания автономного оружия. В то же время гражданские ведомства США, такие как Министерство энергетики и Министерство финансов, заинтересованы в использовании Mythos для выявления уязвимостей в энергосетях и банковской системе перед лицом внешних киберугроз, и споры между Anthropic и Пентагоном не являются для них препятствием. При этом некоторые чиновники признают, что, несмотря на личные симпатии к позиции Пентагона, инструменты Anthropic являются лучшими в классе для обеспечения национальной безопасности. На текущий момент компания ограничила доступ к модели Mythos узким кругом организаций, чтобы те могли оценить все её чрезвычайно мощные возможности, связанные с противодействием киберугрозам. |